Educação pública terá fase de testes para uso de IA

Projeto aposta em ambiente controlado para analisar impactos da IA no ensino antes da ampliação em larga escala

A inteligência artificial já se integrou à rotina de escolas e universidades, alterando a forma de ensinar, aprender e avaliar. No Brasil, esse movimento ganha contorno institucional com o lançamento, em 2026, pelo Ministério da Educação (MEC), do primeiro Sandbox Regulatório de IA voltado ao ensino público, com inscrições abertas entre 30 de março e 13 de maio. Para Clara Cecchini, especialista em aprendizagem e inovação, graduada pela Unicamp, com MBA pela FGV e formação complementar na Kaospilot e na Schumacher College, na Inglaterra, a proposta destaca-se por ser uma abordagem baseada na experimentação intencional com riscos controlados, necessária neste momento.

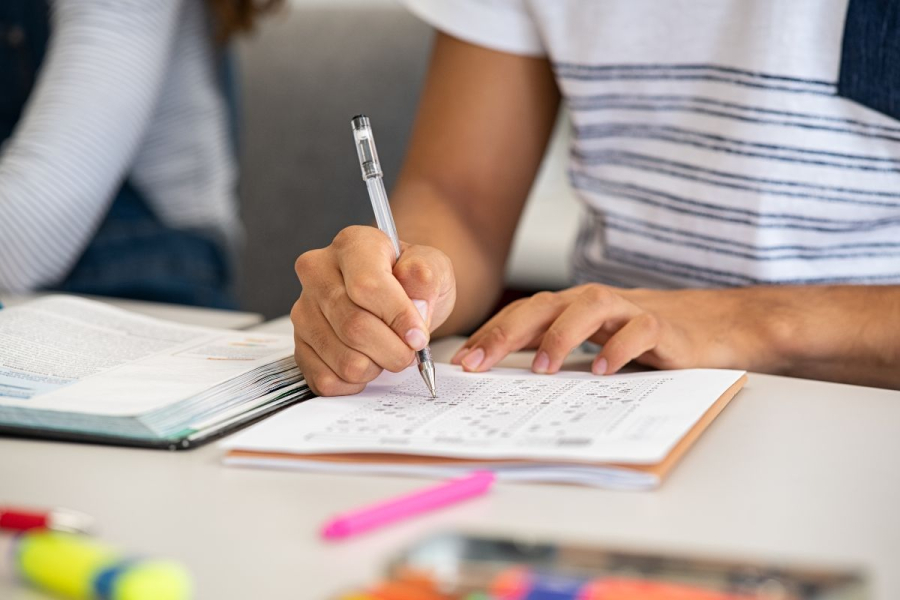

Desenvolvida em parceria com a Advocacia-Geral da União, por meio do Laboratório de Inovação, a iniciativa prevê testar, em ambiente supervisionado, até oito soluções tecnológicas ao longo de três meses. A proposta reúne universidades, empresas, organizações da sociedade civil e gestores públicos, com o objetivo de produzir evidências que orientem políticas públicas. O desenho inclui critérios de segurança, transparência e proteção de dados, além de mecanismos de acompanhamento contínuo.

A criação de um ambiente controlado para testes, segundo Clara, responde a uma lacuna recorrente na relação entre inovação e regulação. “O que vejo, muitas vezes nas organizações, é uma dificuldade de criar esses espaços para uma experimentação real, sem a necessidade antecipada de garantias ou cases de sucesso que justifiquem a decisão. É preciso criar estratégias para que a busca por segurança não acabe travando a inovação”, afirma. Para ela, contextos que ainda enfrentam entraves regulatórios para testar soluções podem oferecer aprendizados relevantes sobre como estruturar essa transição.

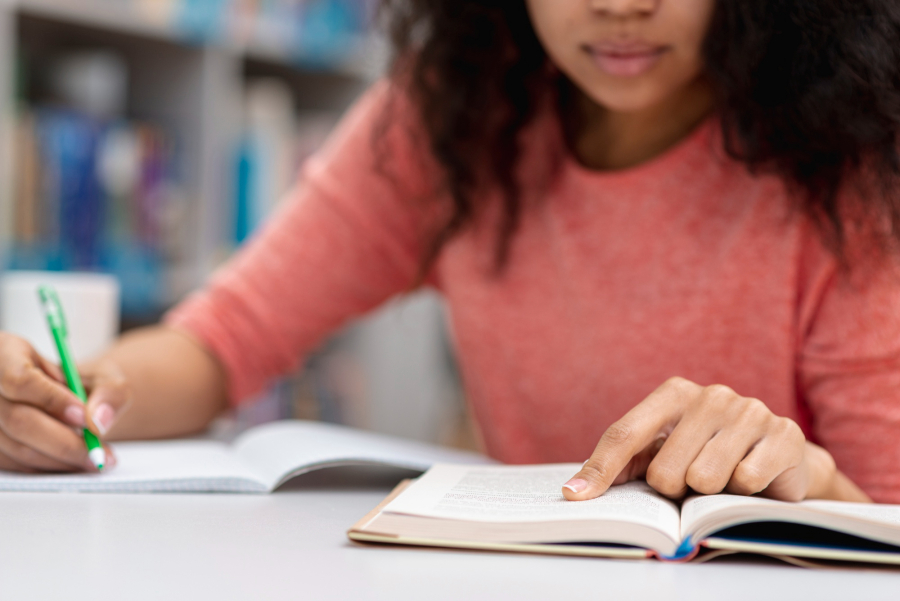

Ao mesmo tempo em que o sandbox propõe um período de observação antes da adoção em escala, o cotidiano das instituições já reflete os efeitos diretos da incorporação da inteligência artificial. Na educação básica, por exemplo, a tecnologia pode ser aplicada à aprendizagem, ao apoio ao professor e à gestão. “Os impactos são múltiplos e atingem diferentes partes do trabalho. Tudo o que está no coração da atividade docente, como pesquisa, preparação de aulas, avaliação, está sendo atravessado pela IA”, diz Clara.

Na prática, o que se observa não é necessariamente a redução de tarefas, mas uma reconfiguração da carga de trabalho. Estudos recentes indicam que a tecnologia tende a intensificar o ritmo, ao facilitar a abertura simultânea de frentes e ampliar o volume de entregas esperadas. A isso se soma uma camada adicional: a necessidade de formar alunos para o uso ético e transparente dessas ferramentas, independentemente da disciplina. “Além do trabalho técnico, cresce a demanda por discutir riscos, responsabilidades e novos pactos de integridade”, afirma.

Esse deslocamento também pressiona as instituições a assumirem um papel mais ativo na organização do trabalho. Para Clara, o debate ainda está excessivamente centrado no indivíduo, quando deveria avançar para o desenho de sistemas. “Isso implica definir com clareza onde e como a IA pode ser utilizada, revisar métricas que privilegiam volume e velocidade e estabelecer limites concretos de uso. Não basta decidir onde usar, é preciso decidir onde não usar”, resume.

Outro ponto de atenção está na natureza do trabalho pedagógico. Embora ferramentas de IA consigam gerar conteúdos e feedbacks em escala, a aprendizagem continua ancorada na relação humana. “Mesmo quando a qualidade técnica é comparável, o fato de haver um ser humano por trás faz diferença no aprendizado”, diz Clara. A expansão indiscriminada de soluções automatizadas, segundo ela, pode alimentar uma lógica de substituição que não se sustenta na prática e ainda produz insegurança entre profissionais.

COMENTÁRIOS